Depuis le lancement de ChatGPT en 2022, de plus en plus d’utilisateurs se servent de l’intelligence artificielle pour créer des contenus tels que des publications, des images mais également des articles. Selon une étude[1] de l’agence Graphite, spécialisée dans le SEO et AEO, plus de 50% des articles mis en ligne aujourd’hui sont rédigés par des intelligences artificielles comme ChatGPT, Claude ou Gemini.

Face à ce constat, on a vu naître ces dernières années de nombreux outils de détection de contenus générés par l’IA, combinés avec la détection de plagiat : mais dans quelle mesure on peut leur faire confiance ?

Quels sont les meilleurs outils de détection ?

Les outils de détection de plagiat en ligne ne sont pas une nouveauté : depuis la démocratisation d’internet au début des années 2000, beaucoup d’internautes ont utilisé des contenus en ligne pour enrichir leurs travaux. Le milieu scolaire est celui où la question de l’authenticité des textes est la plus débattue.

Aujourd’hui, en plus des sources librement accessibles sur le web, s’ajoutent les IA capables non seulement de fournir des contenus déjà existants, mais aussi d’en générer de nouveaux, rendant la détection presque impossible.

Pour cette raison, des outils de détection de l’IA ont été créés, souvent combinés à des fonctionnalités de détection de plagiat.

La plupart de ces outils sont payants et proposent des abonnements mensuels et annuels qui donnent accès à des crédits : chaque crédit permet l’analyse d’un certain nombre de mots, variable selon la plateforme utilisée.

Parmi les outils les plus souvent cités comme étant fiables, on retrouve notamment Originality.IA et Winston.ai, que nous avons eu l’occasion de tester.

Originality.IA permet une analyse gratuite d’un texte de 750 mots, afin d‘évaluer s’il a été rédigé par une IA ou pas. Toutefois, pour accéder à la détection de plagiat ou analyser des plus longs textes, il est nécessaire de prendre un abonnement à partir de 14,95€ par mois.

Winston.ai propose de son côté 14 jours d’essai gratuits permettant d’analyser jusqu’à 2000 mots au total, l’équivalent de 2 petits articles ou d’un seul article d’environ 6 pages Word. La vérification du plagiat, même dans ce cas, n’est pas incluse et nécessite d’un abonnement dit « avancé » à 29€ par mois.

Mention particulière aussi pour Lucide.ai, le premier outil de détection 100% francophone qui toutefois ne propose pas d’essai gratuit.

Quelle est la fiabilité de ces outils ?

Chez Kern Consulting nous nous sommes interrogés sur la nécessité d’une entreprise d’investir dans un outil de détection d’IA et de plagiat afin de garantir l’exactitude et l’authenticité des contenus publiés.

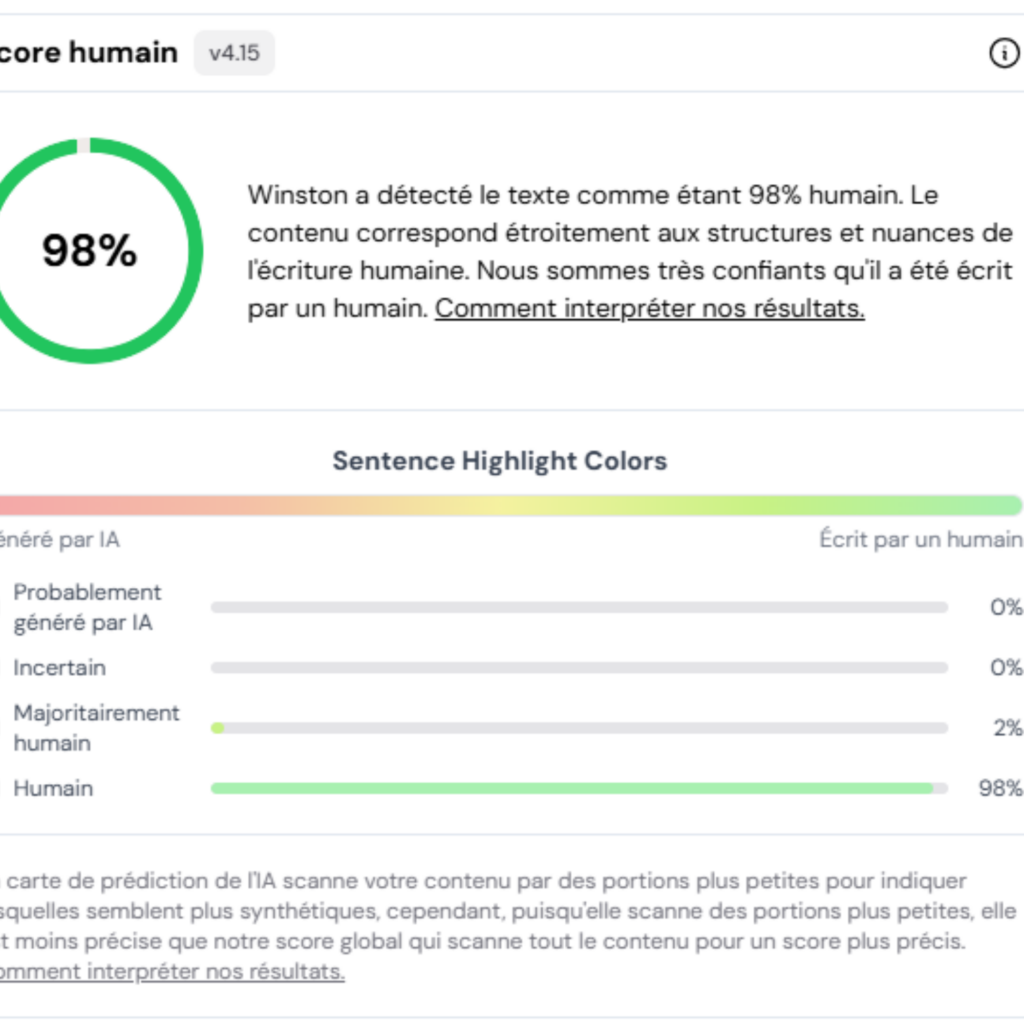

Nous avons alors testé les versions payantes d’Originality.IA et Winston.ia sur nos propres articles écrits par nos consultants.

Pour tous les articles analysés, nous avions la certitude qu’ils ont été écrits par des humains et les résultats ont été surprenants :

- La plupart ont obtenu un score entre 70 et 100% de « écriture humaine » sur les 2 plateformes.

- Pour certains, les 2 outils ont donné des résultats contradictoires : si l’un a détecté de l’IA, l’autre ne l’a pas détecté ou a détecté un faible pourcentage. Quel est donc le niveau de fiabilité ?

- Un seul article a eu des scores moins satisfaisants, avec des pourcentages d’écriture IA compris entre 40 et 90%, variables selon la plateforme utilisée.

Nous avons interrogé l’auteur de cet article et il a avoué d’avoir utilisé l’IA pour la reformulation et correction d’éventuelles fautes d’orthographe. Est-ce que cela est une raison suffisante pour être suspecté d’avoir utilisé une IA ?

Une chose est certaine : les outils de détection ne sont pas fiables à 100%. En effet, le pourcentage exprimé ne représente pas la part de texte écrite par une IA mais plutôt la probabilité que le texte ait été généré par une intelligence artificielle.

Pour ce qui concerne le plagiat, les résultats ont été assez satisfaisants : toutes les 2 plateformes ont pu identifier nos articles déjà publiés en ligne et y détecter le plagiat.

Pour challenger davantage les outils, nous avons testé 2 textes plus courts écrits pour les réseaux sociaux et le web par un humain mais avec des parties reformulées par une IA : pour seulement 1 de ces textes, Winston.ai a pu détecter un pourcentage de IA.

Enfin, nous avons testé des extraits de 3 livres littéraires dans leur langue originelle : 1 de la littérature française, Du côté de chez Swann, 1 de la littérature italienne, Il Barone Rampante, et 1 de la littérature anglaise, The picture of Dorian Gray. Les 2 outils ont détecté uniquement le plagiat et indiqué le texte comme étant humain.

Toutefois, quand nous avons demandé à Gemini de nous donner exactement les mêmes extraits et nous avons copié-collé le résultat de Gemini, l’outil Originality.IA a reconnu un score de 100% IA pour le texte en italien, bien qu’il s’agissait exactement du même texte analysé juste avant.

Comment marche la détection ?

Le principe de fonctionnement de ces outils est assez simple. En général, ils se basent eux-mêmes sur un modèle de langage avec intelligence artificielle et ils calculent quel mot est le plus susceptible d’être utilisé à la suite dans le texte. Comme l’IA travaille avec des modèles linguistiques semblables, il en résulte par ce biais une forte concordance pour les textes générés par une IA. En revanche, si le texte est écrit par l’auteur, les divergences devraient être si importantes que l’outil de vérification de l’IA identifie le texte comme étant écrit manuellement.

Les deux principaux éléments déterminant la prédiction sont :

- La perplexité : C’est-à-dire la façon de mesurer la prévisibilité des choix de mots. Les modèles d’IA sont entraînés à choisir le mot statistiquement le plus probable, ce qui peut rendre leur écriture un peu trop lisse et logique.

- La variabilité (burstiness) : Cela concerne la diversité dans la longueur et la structure des phrases. Les humains varient naturellement leur style, utilisant des phrases longues et fluides à côté de phrases courtes et percutantes. Le texte généré par l’IA peut parfois sembler plus uniforme et manquer de ce rythme naturel.

Exemple :

| « La famille s’est rendue à la gare pour prendre le train. » | « La famille s’est rendue à la gare pour récupérer les amis qui ont pris le train et les emmener directement au zoo en scooter électrique. » |

La première phrase est très simple et a une suite très prévisible : les contenus s’enchaînent logiquement et la deuxième partie de la phrase est exactement ce à quoi le lecteur s’attendrait. C’est là que se situe le problème : l’IA génère très souvent des phrases dont le contenu est prévisible, car elle n’a pas la créativité dont font preuve les humains lorsqu’ils rédigent des textes. Pour cette raison la première phrase sera plus probablement indiquée comme étant écrite par une intelligence artificielle.

Les autres éléments qui peuvent influencer les détecteurs d’IA sont les métadonnées et les filigranes. En effet, dans les textes produits par une IA on peut trouver des signaux invisibles qui ne peuvent être détectés que par des algorithmes spécifiques propres aux outils de détection.

Entre faux positifs, faux négatifs et méfiance

Lorsqu’un détecteur signale à tort un texte écrit par un humain comme étant généré par l’IA, nous nous trouvons face à un faux positif.

Cela arrive plus souvent qu’on ne le pense : une étude de l’Université de Stanford[2] a révélé que la plupart des détecteurs d’IA montrent un biais significatif contre les rédacteurs non natifs en anglais, signalant fréquemment leur travail simplement parce qu’ils utilisent souvent des structures de phrases et des choix de mots différents ou plus simples que les natifs.

A l’inverse, un faux négatif se produit lorsqu’un détecteur ne parvient pas à identifier un contenu généré par l’IA et le classifie comme humain. Parfois, un prompt bien rédigé ou le simple fait de demander à une IA d’écrire dans un style plus « humain » suffit à passer inaperçu.

En réalité, il faut reconnaitre que tous les textes sont désormais rarement « purement IA » ou « purement humains ». Il s’agit en grande partie de contenus hybrides, édités, reformulés avec une IA et paraphrasés à plusieurs reprises et dans de telles conditions contradictoires, la précision de nombreux détecteurs chute sensiblement.

Conclusion

Peut-on vraiment faire confiance aux outils de détection d’IA ? La réponse est nuancée. Aucun outil ne garantit des résultats fiables à 100%, surtout dans le contexte actuel où les IA ne sont pas utilisées pour la rédaction à l’aveugle d’un texte mais surtout pour corriger, reformuler ou encore aider à drafter un texte écrit par un humain.

Cependant il serait erroné de dire que les outils de détection de IA sont inutiles : ils permettent d’identifier un pourcentage approximatif d’écriture artificielle d’un texte ou même de tester nos propres contenus avant publication et les modifier s’ils sont suspectés d’être écrits par une IA.

L’approche la plus pertinente est de tester pour une période définie deux ou trois outils et enfin choisir celui qui s’avère le plus fiable au regard de vos propres évaluations internes. En définitive, la détection automatique en ligne est semblable à l’état de l’art actuel de l’IA, elle ne remplace pas ni le jugement humain ni une politique éditoriale claire : elle doit plutôt être envisagée comme un outil d’aide à la création ou vérification, et non comme une vérité absolue, le jugement final devant passer au filtre de la critique d’un être humain.

Sources :

- https://siecledigital.fr/2025/10/21/une-etude-revele-que-50-des-contenus-en-ligne-seraient-generes-par-ia/

- https://www.youtube.com/watch?v=xxF-0QbNYRc

- https://graphite.io/five-percent/more-articles-are-now-created-by-ai-than-humans

- https://tool-advisor.fr/blog/detecteur-contenu-ia/

- https://www.digit-formations.fr/nos-articles-de-blogs/15-d%C3%A9tecteurs-de-contenu-ia-%C3%A0-conna%C3%AEtre-en-2025-(comparatif-complet)

- https://www.merci-app.com/fr/article/top-6-des-detecteurs-ia-fiables-en-2026

- https://proredaction.com/logiciels/meilleurs-detecteurs-ia/

- https://www.textbroker.fr/la-non-fiabilite-des-detecteurs-dia-comprendre-et-gerer-au-mieux-les-faux-positifs

- https://www.eesel.ai/fr/blog/how-accurate-are-ai-detectors

- https://hai.stanford.edu/news/ai-detectors-biased-against-non-native-english-writers

[1]Five Percent – Graphite Agency, More Articles Are Now Created by AI Than Humans (2025) https://graphite.io/five-percent/more-articles-are-now-created-by-ai-than-humans

[2] Stanford Institute for Human-Centered AI, AI-Detectors Biased Against Non-Native English Writers (2023) https://hai.stanford.edu/news/ai-detectors-biased-against-non-native-english-writers